Robot educativi e umanoidi

Le tematiche legate all’Intelligenza Artificiale (IA) sono molto interessanti e ora, grazie ad alcuni prodotti, si possono sperimentarle in modo semplice e concreto. Ecco qui di seguito alcuni esempi.

Il linguaggio di programmazione mBlock di Makeblock, basato su Scratch, offre delle cosiddette estensioni (blocchi aggiuntivi) per utilizzare i Servizi Cognitivi (riconoscimento vocale, di testo scritto ossia OCR, dell’età, del genere e dello stato emotivo delle persone, l’analisi del “sentimento” di un testo) e il Machine Learning (apprendimento automatico per riconoscere e classificare oggetti, senza programmazione).

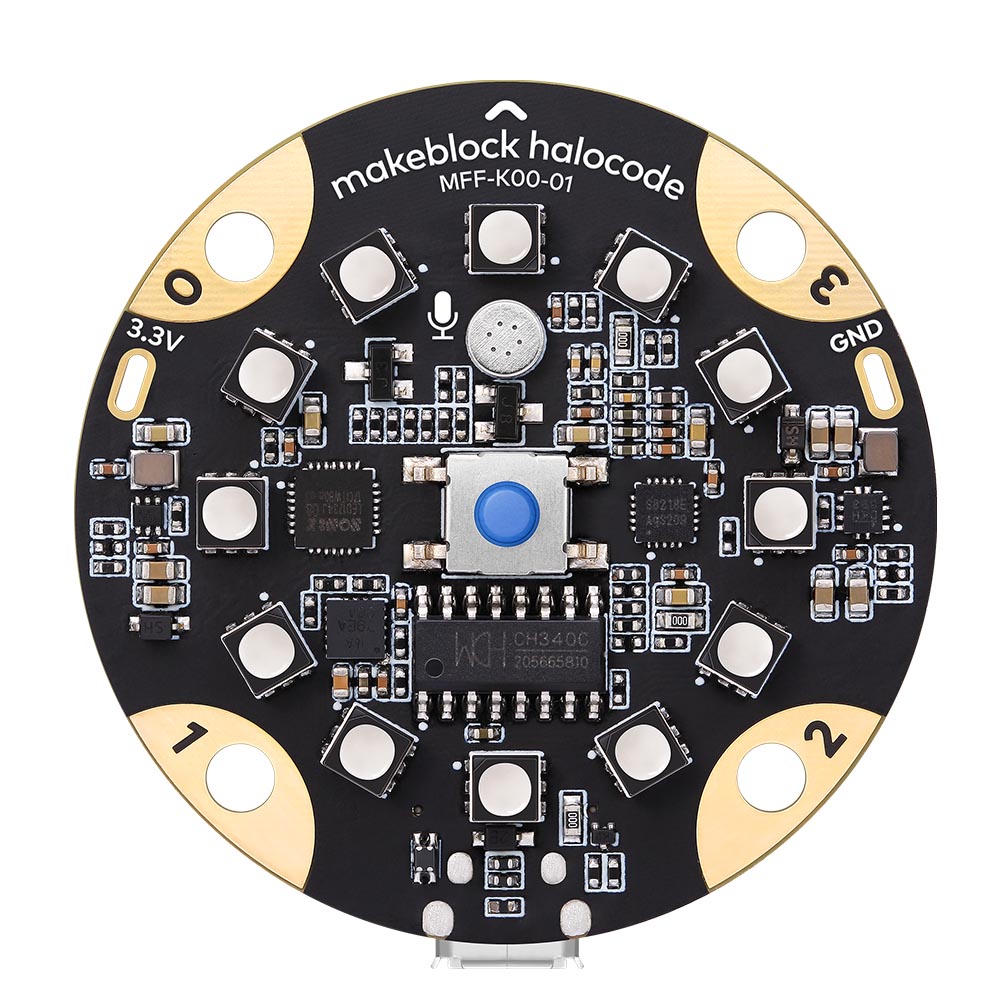

Pertanto, grazie a questi blocchi intelligenti di IA, i robot educativi basati sulla scheda Halocode o su mBot2 possono sfruttarli direttamente per compiere azioni innovative e molto avanzate (accendere/spegnere luci con comandi vocali, comprendere un cartello stradale e agire di conseguenza, ecc.). Un’altra possibilità molto interessante consiste nell’utilizzare la Smart Camera di Makeblock per riconoscere oggetti: ad esempio mBot, equipaggiato con la Smart Camera, potrebbe identificare una pallina e seguirla fino a recuperarla.

|  |

Grazie al linguaggio di programmazione DobotBlock di Dobot, basato anch’esso su Scratch, possiamo aggiungere intelligenza artificiale al braccio robotico didattico Magician Lite. Infatti, l’estensione di IA consente di sperimentare in modo semplice alcune funzionalità che invece sono molto avanzate, quali il riconoscimento vocale (speech to text), sintesi vocale (text to speech), traduzione tra lingue, analisi di immagini e loro classificazione (Machine Learning), genere e stato emotivo delle persone e testo scritto (OCR). In questo modo possiamo sviluppare dei programmi in cui il braccio robotico può riconoscere le merci e prenderle e depositarle in scaffali dedicati, separare i rifiuti in base alla tipologia dopo aver istruito il modello di classificazione degli stessi, riconoscere la frutta e raccoglierla e depositarla negli appositi contenitori e così via.

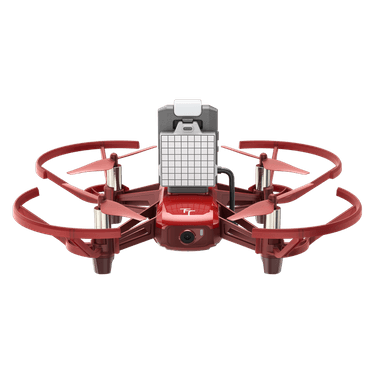

Il nuovo drone educativo RoboMaster TT di DJI, oltre a volare permette tutta una serie di applicazioni di Intelligenza Artificiale: percezione ambientale (con la tecnologia di rilevamento a infrarossi e i dati delle informazioni sugli ostacoli) per disegnare mappe di interni ed evitare ostacoli, riconoscimento facciale e inseguimento (visione artificiale, deep learning e rete neurale), riconoscimento e controllo del drone mediante gesture. Come ambienti di programmazione sono possibili: programmazione grafica, Arduino, MicroPython e SDK.

Sempre DJI ha realizzato RoboMaster EP Core un robot mobile educativo con ruote omnidirezionali e pinza per prendere oggetti, munito di videocamera e potenziato anch’esso con funzioni avanzate di Intelligenza artificiale: può localizzare oggetti anche in movimento e seguirli, riconoscere ostacoli e aggirarli, fare operazioni di pick and place e altro ancora. L’EP Core supporta i linguaggi di programmazione Scratch e Python, consentendone l’utilizzo a tutti i livelli.

|  |

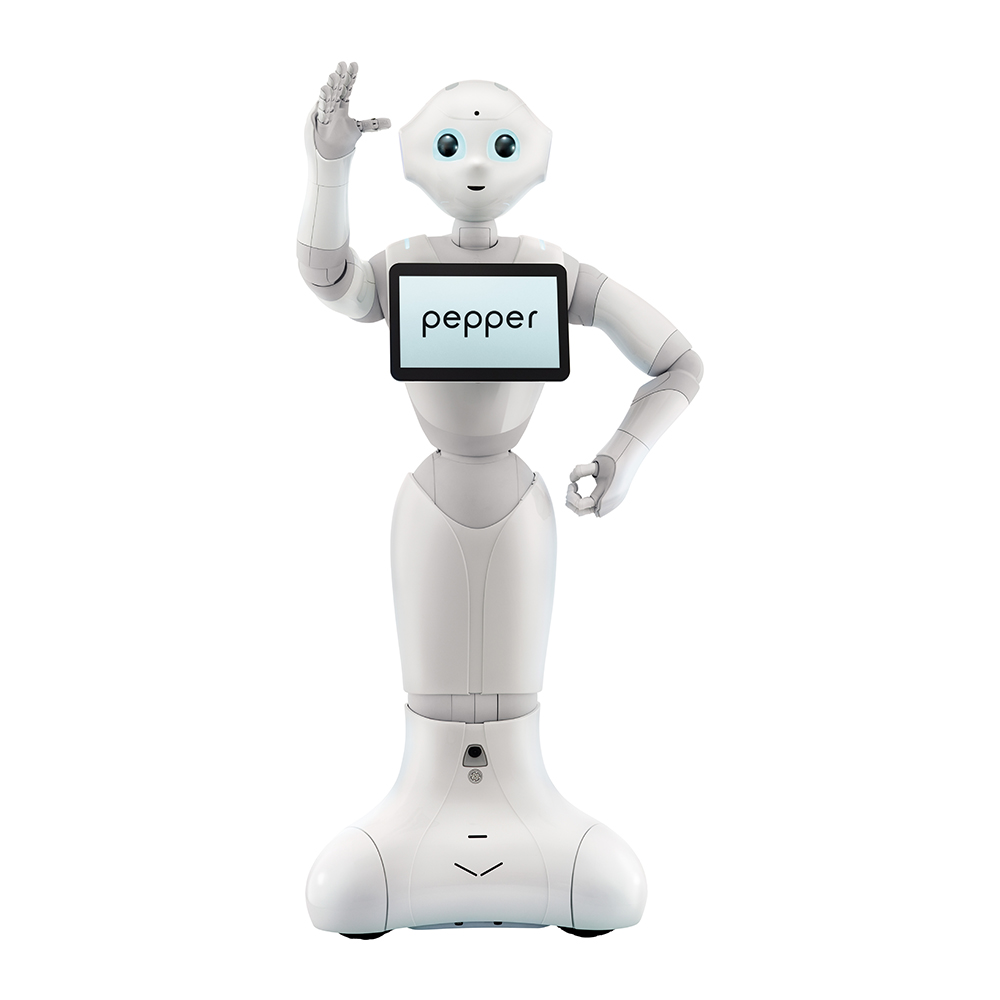

Nel settore dei robot umanoidi i due famosi Nao e Pepper offrono già delle funzioni integrate di intelligenza artificiale per il dialogo e per la comprensione dell’essere umano. Inoltre, sia Nao sia Pepper possono essere potenziati con i servizi di intelligenza artificiale, ad esempio integrandoli con i servizi cognitivi di Microsoft, IBM e Google per comprendere meglio l’ambiente circostante o dialogare in modo avanzato. La programmazione di Nao e Pepper avviene in un ambiente grafico a blocchi chiamato Choregraphe che offre la possibilità di programmare anche in Python.

|  |